�� 2016 �����羭����̳��WEF������˹����ϣ�ȫ��ݼӢ�۽���һ���һ�����¡������⣺�����Ĵι�ҵ�����������������ƶ����Ĵι�ҵ��������Ҫ���������˹����ܣ�AI�����˺����� AI ������������ǵض������������ڿ���Ȧ������ҵ�ﶼ����һ����ѧ������Ҳʵ�����鵽 AI �����IJ���˼�顣 ���������������ҵ��뢡�������˾����ӵ�� AI �����������Ͽ�ѧ�ҡ�����ѧϰר�ҵ��˲ŵ��������������Dz���������������춯��¶������ҵ���ڽ��м��ҵ����˴���ս��ȥ�꣬�С�ƻ�� Swift ����֮���������� Chris Lattner���뿪ƻ��������˹��Э�������Զ���ʻ���壬���˰����漴���� Google Brain �Ŷӡ� ���� 2 �µף�����ѷ Alexa AI ������ Ashwin Ram ���۹ȸ裬��Ϊ�ȸ��Ʋ��� AI �����ܼࡣ4 �£����� Google �˹��ǻ�����Ѱ���Ÿ����˵� John Giannandrea ������ְͶ��ƻ�����£�����ƻ������ѧϰ�� AI ս���ܼࡣ8�£�ǰ��˹����ϯ����ʦ������ Model 3 ������ Doug Field���ػ�ƻ�������������з��Լݳ� Project Titan �ƻ����������������2017��������˹�����ж�� 46 λ��˹��Ա�����۵�ƻ��������˹����������˹�˸е�ʹ�ࡣ �ڹ��ڸ߽��˲����۵����Ҳ���̶��ã�ǰ����ѷ�������ο�ѧ����С����ȥ�����۰���Ͱͣ������˹��ǻۺ����Ŷ� iDST ��ϯ��ѧ�Һ�Ժ�������������Ӱٶ�תս��Ѷ���� AI Lab ���Σ��Լ��ٶȲ��� AI ��ؼ����ĸ߹ܻ�ר����ְѡ�����д�ҵ�����ڣ�����һ�� AI �����ǵ��춯ͬ���ܵ���ע���Ǿ������� NVIDIA ����ѧϰ�о��ܼ�� Anima Anandkumar�� �������� AI ���� ��ȥAnima Anandkumar����ֵһ��ͻ��������Ԫ������ѷ���� AWS ���ѧϰ���ο�ѧ�ң���ʲôԭ�����������������������Ϊ���Ĺ�˾��ת������Ӳ����˾Ӣΰ� ���ҵ������Ǵ���Ӣΰ����о���Χ��һ�����ɳ���ͬʱ���ѧ��������ϵ���� Anima Anandkumar ���� DT ��ר��¶���¹��������ݼ����� ��ȥ��ҵ�� AI Ͷ��Ĺ�ע���٣���˽��� AI �ٶ���������˾���Ǵӿ�������Ѱ�Ҹ��֣��� ����ѷ��Ϊ Anima Anandkumar ��һ��������ҵ��Ĺ���֮ǰ�����Ǽ��������Ǵ�ѧ�����У��UC Irvine�������������Ѷ��ѧϵ��EECS Department�����������ڣ��о���Ȥ�������ģ����ѧϰ�����Ż���non-convex optimization����άͳ�ơ� 2010 �������Ǵ����ݸ����Ŀ�ʼ�������ͼ�ҳ��ܹ����ģ�������ݵ��㷨���������õ����ۣ�����ʼ�о�DZ�ڱ�����latent variables����������Ѷ�������ʱ�����Ǿ�������һЩ�����ص����أ��������ֻ�����������������Ļ�����ʵ�ǿ��Ա���ʶ�����ġ�����������tensor���о�����ͳ���һ���ⷨ�����������һ�Ա���֮��Ĺ�ϵ�����dzɶԵ�����ԣ���������뿼�� 3 ������߱���֮��Ĺ�ϵ�������Ҫ����������˵��

ͼ | Animashree Anandkumar ���ҵ�Ŀ������������ÿ���˶�����ʹ�û���ѧϰ�������ǻ���ѧϰ��Ӧ��������̷����ר�ң���С���ƶ����۵�������صĺ蹵������ˣ��ü������������ҿ���ʵ����ؾͳ�������ʹ�������� AWS �ڼ�һֱ�쵼�����㷨�Ŀ����ͷ�����������Щִ���� AWS �ϵ�Ӧ�á������Ч�ʣ����ҿ�����ģ̬�����㷨������ͬʱ�����ı���ͼ����������ģģ̬��Ϊ Apache MXNet ����˿ɱ���Ժ������ԡ� �����е�Ӣΰ������ʲô�Ĺ�˾�� ������֪������ѷ������ AI ���������ȵĹ�˾֮һ��Ӣΰ������� AI �����㷭�����������ڶ�� AI ģ�ͱ��������� GPU ǿ������������������˱���Ϊ�ǡ��ṩ AI ����ĵ�ҩ�̡����ۼ���ʵ��ͬ����λ�� AI ����Ⱥ�ֻ������Ӳ����˾����ҵ�Ļ������ܲ�ͬ�����ҹ�˾����ҵģʽҲ�����Ĵ� ��Ϊʲô�������ʱ�̼���Ӣΰ�������˵��Ӣΰ����һ��ʲô���Ĺ�˾����DT �����ʡ� ��NVIDIA��һ�ҷdz����д��¾���Ĺ�˾������㿴���Ĺ켣����һ����ͼ�μ�����Ϊ�����Ĺ�˾�������˸����ܼ���ĸ������ٵ����ڵ��˹����ܣ������ѧϰ���˹ؼ����ã�������̫�����ˣ�Ψ�е�һ�ҹ�˾�߱����µ�DNA�����п���ʵ����һ�㣬�������ŵ�˵�� ��Ҳָ����Ӣΰ�ﲻ������һ��Ӳ����˾����CUDA ��ʽ�⣨library���Ŀ���һֱ����չ���ѧϰ�Ĺؼ���CUDA primitives Ҳ���ҵ������о��йء�������ǰ��Anima Anandkumar ��Ӣΰ���о���Ա Cris Cecka һ��Ϊ����������tensor contraction���IJ�����������չ�� BLAS �ںˡ������|��֮�ᣬ������Ϊ CUDA �е�����������tensor algebraic�������ṩ����֧�֣�����܉������Ч������������ܹ��� ��Ӣΰ��֮��Ҫ��ʲô�� ����Ӣΰ��Ŀǰ�����ij��� AI ֮�⣬�����Զ���ʻ��������˺������Ƿ������Զ���ʻ���������������о�Ҳ��Ӧ�����Զ���ʻ��������� DT �������ʣ����ش��������Թ㷺���ã�����������ѧϰ��ܶ������������������ǹȸ�� TensorFlow��Ӣΰ��� Tensor Cores �ȡ�����˵�������Ƕ�ά���У�������ѧ�Ͻ�������Զ��ֹ�ڴˣ�����ھ������������ø��ḻ�ķ�ʽ�����������������ֻ�������������ϣ���˻��ҳˣ�����������������ķ�ʽ����������

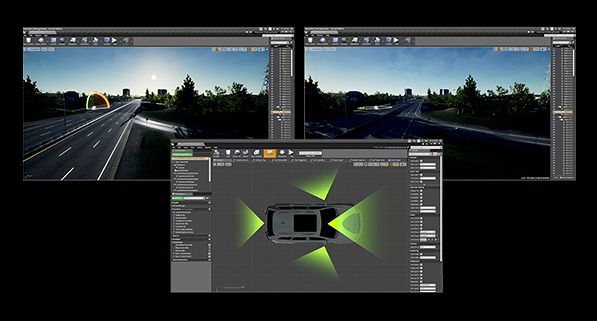

ͼحNVIDIA DRIVE Constellation����Դ��NVIDIA �� ����һ��ָ���������ֽ����е����������ֻҪ��ֻ�漰�������㣬�ḻ����������Ϳ�����չ�����С����ҵ��о������ڼ�����Ӿ���ʱ������Ԥ��ȸ�����������������������ӽ�ʵ�����գ����ҿ��Ը�ͨ�á����ڴ��� NVIDIA ��һ����չ�й�����������������о����� �������㷨�������ˣ����������� |

��һƪ��Ң���ƻ����������컥���������ѯ��ҵ��ѵ��֤��ϵ

��һƪ��Ȥͷ��û�л��Ǻ�

- ���Խ���ʱ��Ů��һ��������3����֣����˾�Ҫ�����뿪(2018-10-14)

- �뿪����ѷ����λŮ�Կ�ѧ�ҽ���ΪӢΰ�������Щ�ı䣿(2018-10-01)

- �뿪������Ԫ���ֲ�����ѷ������ΪӢΰ�������Щ�ı䣿(2018-09-22)

- �뿪������Ԫ���ֲ�����ѷ������ΪӢΰ�������Щ�ı䣿(2018-09-22)

- �����������Q�����ε�����ƽ����

- ���������أ����˶�Ů�˵�8������ϣ��(ͼ)

- ��ʳ��������ʲô�������٣� ʮ��ƽ��ˮ���а�

- ��ͥ��������ָ��������ǰ���ļ�����Ŀ��������

- �������˳�ƶ����������ƶ��������չ��������

- ��ֱ�Ǹ�����0��320�� ���ϡ�������һ�ߡ���

- ¶����� ������ 2018Ңɽ��Ҷ�ڽ��������ڿ�

- ��Ʒλ�����ŷʫ�����±��ܹ��Ů�Ի�ӭ

- ����ְԺ���Ų鰲ȫ���� �������쳤��

- ��������ʦ����߿� ���ǿ������ְҵǿ

- ������ˬ���ļ��� ��������������ļ���

- �����߳���ʲô�о�����ͼƬ ����Ů���������

- ��������:��Ů�����¡�ʽ �ð�����������(��

- ������Խ����������ݣ���8��ӰƬ��ͺ��Ӷ���

- ���۱�ȥ�귭һ�������������Ͼ����ォȫ�汬

- ����������11����Ϊʲô���÷��¸�����(��ͼ)

- �ӱ���:����Ũ��˾�⡰���š��¼�����

- ��������:�������꼼�������ø�����Щ(��ͼ)

- ʲô�ǰ�װӡˢ ��װӡˢ��ī��Ƥ��ν��

- ��������:�»������ָ�� 3������Ҫ�㶮(ͼ)